AWS Bedrock 챗봇 만들기1 - 어떤 모델을 선택해야할까?

AWS Bedrock 관련 사이드 프로젝트를 해보겠단 의지로 이 책을 읽어 봤었다.

그렇게 이론만 알아두다가 드디어 이제서야....!!

AWS Bedrock을 가지고 이것저것 만들어보려고 한다.

사이드 프로젝트 가보자고!

2025.02.01-[책] Amazon Bedrock으로 시작하는 실전 생성형 AI개발 리뷰

[책] Amazon Bedrock으로 시작하는 실전 생성형 AI개발 리뷰

이번 글에서는 책에 대한 리뷰와 후기 위주의 서평글을 남겨보려고 한다. 간단하게 내용과 구성을 살펴보는 글로, Amazon Bedrock을 직접 사용해보면서 알게 된 내용은 다음글을 참고하면 좋을

pearlluck.tistory.com

이 글에서는 나처럼 AWS Bedrock을 아예 처음 시작하는 작업과정을 담고 있다.

나는 콘솔창부터 낯설었다.. AWS Bedrock에 사용할 모델을 선택하기까지 과정을 기록했다.

보통 간단한 챗봇을 개발할땐 Anthropic의 Claude 3.5 Haiku 모델을 많이 사용하는거 같았다.

그러나 나는 Meta의 Llama3를 사용하고자 한다.

가장 최신(작년 하반기?)에 나온 모델이기도 해서 궁금하기도 했고, 고성능 저비용이라기에 선택했다.

참고로, AWS는 서울리전이 아니라 버지니아 리전(us-east-1)에서 진행했다.

AWS Bedrock 시작하기

처음에 Bedrock서비스에 들어가면 마주하게 되는 화면이다.

여기에서 젤 왼쪽 하단에 [Model Aceess] 를 선택한다.

그러면 이제 Bedrock에서 사용할수 있는 모델들을 확인할수 있게 된다.

주로 Anthropic의 Claude 3.7 Sonnet이나 Claude 3.5 Haiku 모델을 많이 사용하는거 같다.

추가로 DeepSeek나 Meta의 Llama로 사용해볼수 있다!

어떤 모델을 사용해야할까?

몇가지 모델을 추려서 이 중에 선택해보려고 비교를 했다. 그리고 이해를 돕기 위해 GPT도 성능 비교 대상에 넣었다.

- Anthropic의 Claude 3.7 Sonnet

- Anthropic의 Claude 3.5 Haiku

- DeepSeek의 DeepSeek

- Meta의 Llama3

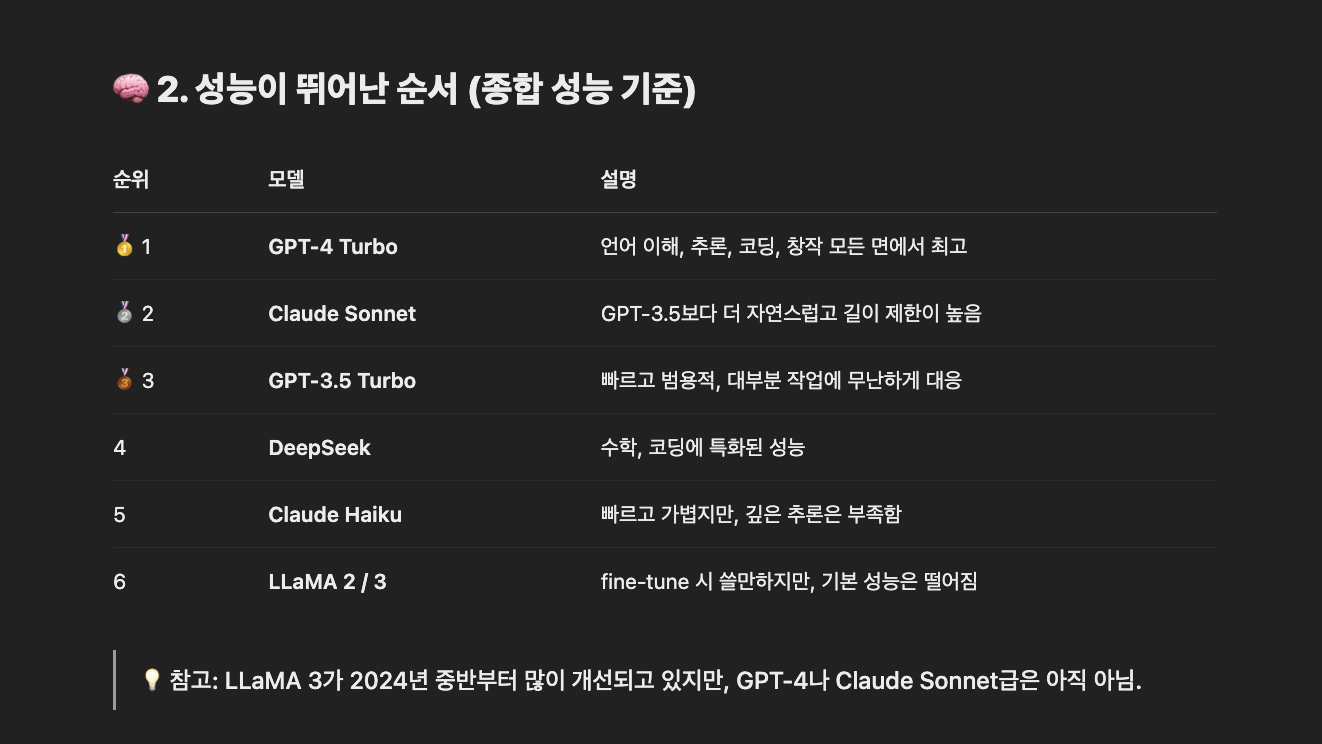

처음에는 이렇게 LLaMA를 2버전으로 알려줬다. 그래서 그런지 LLaMA가 성능이 최하위였는데, 그리고 최신 정보가 아니라고 말해줌ㅡㅡ

그래서 다시 최신 내용을 반영해서 비교해봤다.

비교 결과, 비용이 가장 저렴한 모델은 Claude 3.5 Haiku 였다.

그리고 최근에 LLaMA 3 버전이 많이 개선되었는지, 두번째고 비용이 저렴하고 성능도 뛰어났다.

Claude 3.7 Sonnet 와 DeepSeek 는 조금 비쌌다.

Claude 3.7 Sonnet는 GPT4 정도에 가까운 수준 같고, DeepSeek는 수학적 계산이나 이미지 텍스트를 다룰때 용이하다고 한다.

그리고 성능적인 부분에서 추가적으로 한국어도 어느정도 자연스러운지 궁금했다.

LLaMA 3 버전부터는 멀티링구얼 개선되서 최대 30개의 언어를 지원하고, 그 중 하나가 한국어이다. GPT4 보다는 약간 부족하다고 하지만 그래도 전체적인 성능은 Claude 3.5 Haiku 보다 훨씬 높으니까 고민이 된다...

Claude 3.5 Haiku 자연스러운 한국어를 제공해주지만, 경량모델이라서 빠르지만 얕은 대화만 가능해서 대화형 챗봇 FAQ에만 사용된다.

가장 고민이 되었던 Claude 3.5 Haiku와 LLaMA 3 를 비교한 끝에....

저렴한 고성능 모델인 LLaMA 3 를 사용해보려고 한다!!

그리고 오픈소스라 직접 파인튜닝도 가능하고, 커스터마이징해서 사용할수 있는점도 좋다고 생각했다.

단순한 FAQ, 경량 챗봇보다는 고급 챗봇을 만드는게 실제 서비스하기에도 적합다는 생각이 들었다.

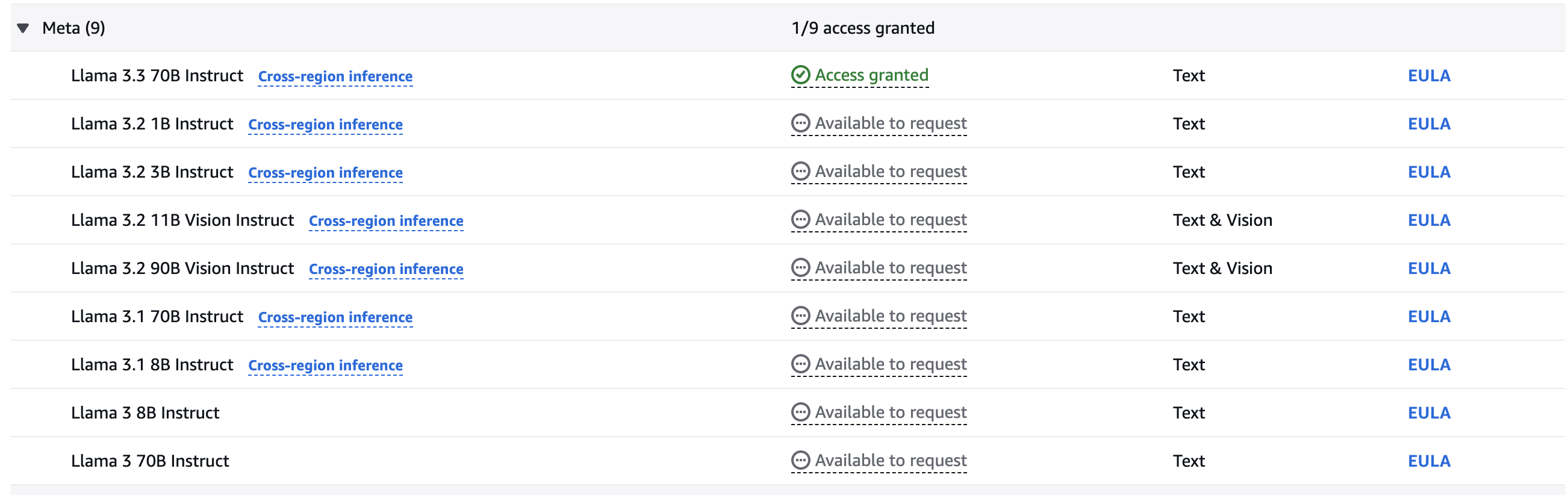

참고로 서울리전에는 이 모델이 전부다..... 버지니아에서 최근 모델을 사용해보는 값을 해야겠어!!!

모델 선택

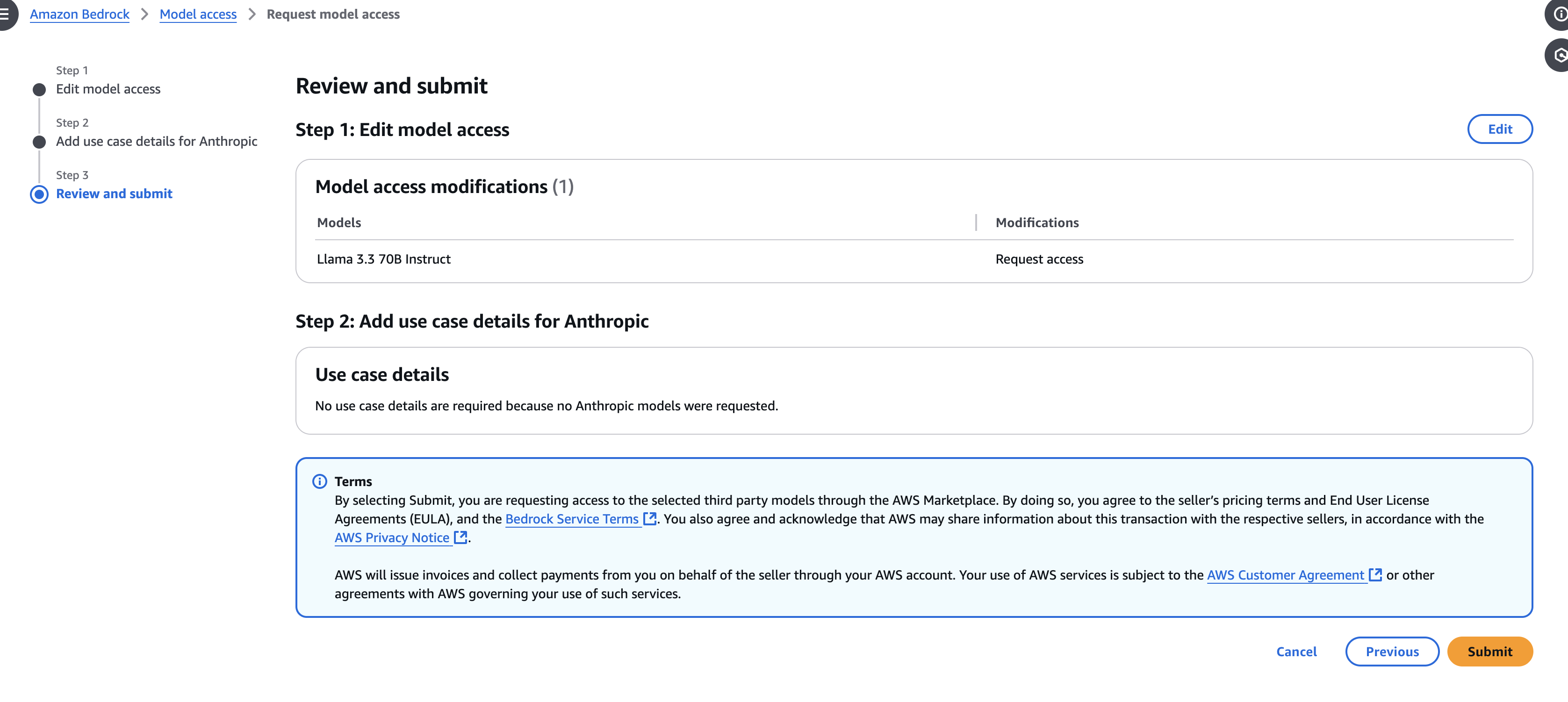

목적에 따라 맞는 모델을 선택했다면, 이제 이 모델을 사용하겠다고 request를 해야한다.

원하는 모델의 [Request model access]를 눌러서 모델에 대한 접근을 요청한다.

이렇게 내가 선택한 모델이 맞는지 확인하고, [Submit] 하면 모델접근 요청 완료!

그러면 이제 최종적으로 이렇게 접근이 승인되었다는 확인을 할수 있다.

이제부터 이 모델을 사용해볼수 있다! 이렇게나 간단하다니..!!

여러가지 모델들의 문서를 읽고 세팅해볼 필요가 없고 원클릭 몇번으로 바로 사용해볼수 있다니..!!

++ 추가로, 궁금해서 Claude 3.5 Haiku 모델도 선택해서 접근해봤다. 대신 이 모델은 사용 details를 적어야했다..ㅎ

여기까지 AWS BedRock을 처음 시작하는것부터, BedRock에 사용할 모델을 선택하기까지 과정을 알아봤다.

결론적으로 나는 고성능 저비용 모델로써 Llama 3.3 70B 모델을 사용하기로 했다. 최신모델이라 버지니아 리전에서 쓸 예정이다.

다음글에서는 내가 사용하기로 한 LLaMA 3 모델이 어떤지 직접 테스트해보려고 한다.

GPT4에 버금가는 실력이라고 하는데, 정말로 어느정도 이해를 잘 하는지 궁금해서 GPT4와 비교해서 테스트해보면 재밌을것 같다!